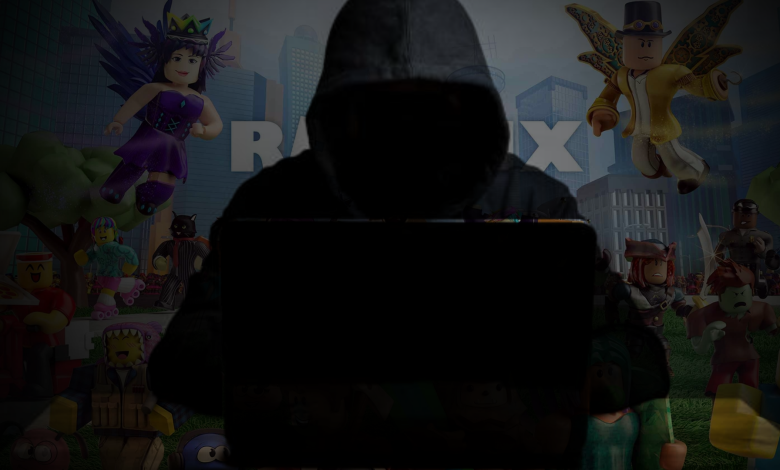

Los riesgos para los niños que juegan Roblox son ‘profundamente inquietantes’, afirman investigadores

Una investigación “profundamente perturbadora” expone lo fácil que es para los niños encontrarse con contenido inapropiado e interactuar sin supervisión con adultos en la plataforma de juegos Roblox .

Esto ocurre cuando los padres compartieron sus serias preocupaciones acerca de que sus hijos experimenten adicción, vean contenido traumático y sean abordados por extraños en el sitio web y la aplicación enormemente populares.

Roblox reconoce que los niños que usan la plataforma pueden estar expuestos a contenido dañino y a actores maliciosos. Afirma que está trabajando arduamente para solucionar este problema, pero que se necesita la colaboración de toda la industria y la intervención del gobierno.

Roblox, que se describe a sí mismo como «el universo virtual definitivo», ofrece millones de juegos y entornos interactivos, conocidos colectivamente como «experiencias». Parte del contenido es desarrollado por Roblox, pero gran parte es generado por los usuarios. En 2024, la plataforma contaba con más de 85 millones de usuarios activos diarios, de los cuales se estima que el 40 % son menores de 13 años.

Si bien la compañía dijo que «simpatizaba profundamente» con los padres cuyos hijos sufrieron daños en la plataforma, dijo que «decenas de millones de personas tienen una experiencia positiva, enriquecedora y segura en Roblox todos los días».

Sin embargo, en una investigación compartida con The Guardian , los expertos en comportamiento digital de Revealing Reality descubrieron “algo profundamente perturbador… una desconexión preocupante entre la apariencia infantil de Roblox y la realidad de lo que los niños experimentan en la plataforma”.

Revealing Reality creó varias cuentas de Roblox, registrándolas para usuarios ficticios de cinco, nueve, diez, trece y más de cuarenta años. Las cuentas interactuaban únicamente entre sí, y no con usuarios ajenos al experimento, para garantizar que el comportamiento de sus avatares no se viera afectado de ninguna manera.

A pesar de las nuevas herramientas lanzadas la semana pasada destinadas a dar a los padres más control sobre las cuentas de sus hijos, los investigadores concluyeron: «Los controles de seguridad que existen son limitados en su eficacia y todavía existen riesgos significativos para los niños en la plataforma».

¿Cuáles son los riesgos?

A pesar de su apariencia inocente, Roblox ha sido escenario de múltiples situaciones problemáticas:

- Grooming: adultos que se hacen pasar por niños para generar confianza y luego obtener imágenes, datos personales o favores.

- Juegos con contenido sexual o violento disfrazados bajo títulos aparentemente inocentes.

- Apuestas encubiertas mediante la compra de monedas virtuales (Robux) en juegos que incitan al azar o al gasto compulsivo.

- Chats abiertos y sin supervisión, donde los menores pueden ser contactados por desconocidos en tiempo real.

El informe reveló que niños de tan solo cinco años podían comunicarse con adultos mientras jugaban en la plataforma, y encontró ejemplos de adultos y niños interactuando sin una verificación de edad efectiva. Esto ocurrió a pesar de que Roblox cambió su configuración el pasado noviembre, de modo que las cuentas registradas como pertenecientes a menores de 13 años ya no pueden enviar mensajes directos a otros usuarios fuera de juegos o experiencias, y solo tienen acceso a los mensajes de difusión pública.

El informe también reveló que el avatar de la cuenta de la niña de 10 años podía acceder a entornos altamente sugerentes. Estos incluían un espacio de hotel donde podían ver a un avatar femenino con medias de rejilla contoneándose en una cama y a otros avatares tumbados uno encima del otro en poses sexualmente sugerentes, y un baño público donde los personajes orinaban y los avatares podían elegir accesorios fetichistas para disfrazarse.

Los investigadores descubrieron que sus avatares de prueba escucharon conversaciones entre otros jugadores que verbalizaban actividad sexual, así como sorbos, besos y gruñidos repetidos al usar el chat de voz. Roblox afirma que todo el chat de voz, disponible para cuentas verificadas por teléfono registradas como usuarios mayores de 13 años, está sujeto a moderación de IA en tiempo real.

También descubrieron que un avatar de prueba registrado por un adulto pudo solicitar los datos de Snapchat del avatar de prueba de cinco años usando un lenguaje apenas codificado. Si bien Roblox afirma que el chat de texto del juego está sujeto a filtros y moderación integrados, el informe señala que este es un ejemplo de la facilidad con la que se pueden eludir dichas medidas, lo que crea oportunidades para comportamientos depredadores.

Roblox dijo que reconocía que «hay malos actores en Internet», pero agregó que este era «un problema que va más allá de Roblox y debe abordarse mediante la colaboración con los gobiernos y un compromiso de toda la industria con fuertes medidas de seguridad en todas las plataformas».

También reconoció que la verificación de la edad para menores de 13 años “sigue siendo un desafío para la industria”.

Entre las historias compartidas por padres tras una denuncia de la Comunidad Guardian se incluyen la de un niño de 10 años que fue acosado por un adulto que conoció en la plataforma y la de una niña de nueve años que empezó a tener ataques de pánico después de ver contenido sexual mientras jugaba.

Damon De Ionno, director de investigación de Revealing Reality, declaró: «Las nuevas medidas de seguridad anunciadas por Roblox la semana pasada son insuficientes. Los niños aún pueden chatear con desconocidos que no están en su lista de amigos, y con 6 millones de experiencias [en la plataforma], a menudo con descripciones y valoraciones inexactas, ¿cómo se puede esperar que los padres moderen la situación?».

Beeban Kidron, colega de la banca cruzada y activista por la seguridad en Internet, dijo que la investigación expuso el «fracaso sistemático de la plataforma para mantener seguros a los niños», y agregó: «Este tipo de investigación de usuarios debería ser rutinaria para un producto como Roblox».

Matt Kaufman, director de seguridad de Roblox, afirmó: «La confianza y la seguridad son la base de todo lo que hacemos. Mejoramos continuamente nuestras políticas, tecnologías y medidas de moderación para proteger a nuestra comunidad, especialmente a los jóvenes. Esto incluye invertir en herramientas de seguridad avanzadas, colaborar estrechamente con expertos y empoderar a padres y cuidadores con controles y recursos sólidos».

“Solo en 2024, agregamos más de 40 nuevas mejoras de seguridad y seguimos totalmente comprometidos a seguir trabajando para que Roblox sea un lugar seguro y cívico para todos ”.

Con Información de The Guardian